Grâce au Microsoft Cognitive Services, il est possible de rendre ces applications plus intelligente en utilisant une multitude d’API.

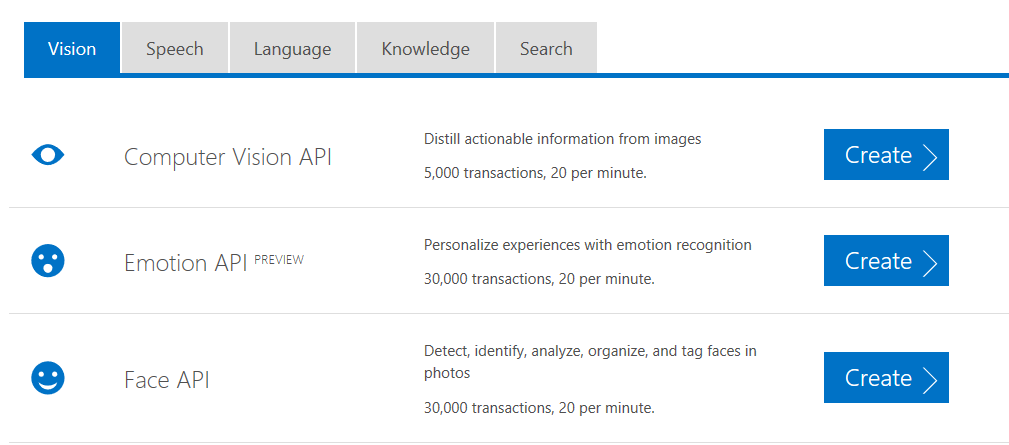

Ces APIs sont découpées 5 catégories :

Vision :

Microsoft propose de puissants algorithmes de traitement d’image.

- API Vision

- API Emotion

- Video Indexer

- API Face

- API Video

Microsoft Speech :

Traitement du langage oral dans les applications.

- Service Vocal Personnalisé

- Microsoft Speech Bing

- Reconnaissance de l’orateur

Langage :

Traitement du langage naturel en évaluant les sentiments et le sujet des textes.

Language Understanding Intelligent Service

- Vérification orthographique

- Speech Translator

- Analyse du texte

- Analyse linguistique

Connaissance :

Correspondance des données et des informations complexes pour effectuer des taches comme les recommandations intelligentes.

- Recommandations

- Connaissances universitaires

- Exploration de connaissances

Recherche :

Optimisation intelligente avec les API de recherches BING

- Suggestion automatique BING

- Recherche vidéo BING

- Recherche d’images BING

Pour notre tutoriel on va attaquer l’API des émotions via du Python

Prérequis

Télécharger Anaconda https://www.continuum.io/downloads ( Python 2.7 / Python 3.2 )

Générer les codes des APIs https://azure.microsoft.com/en-us/try/cognitive-services/

Tutoriel

1. Connectez vous sur https://azure.microsoft.com/en-us/try/cognitive-services/ et choisissez l’API que vous voulez utilisé puis cliquez sur Create.

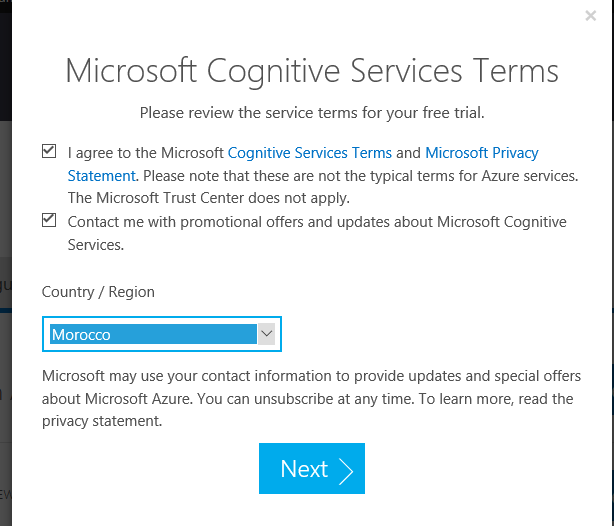

2.Sélectionnez votre pays puis cliquez sur Next

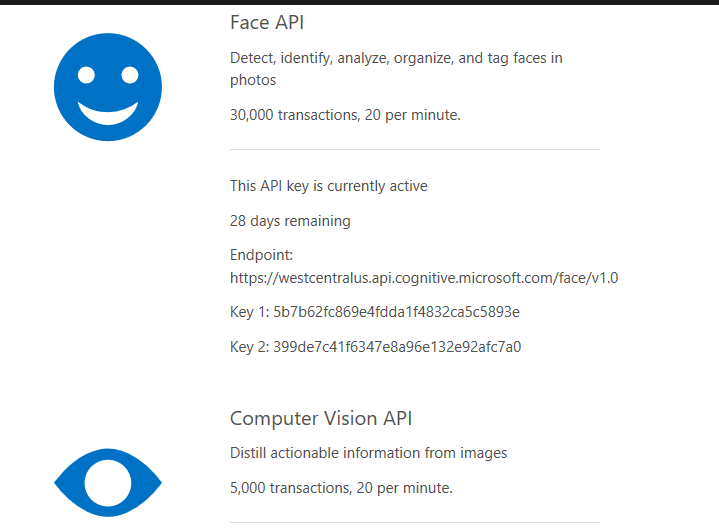

3.Récuperez vos crédentials

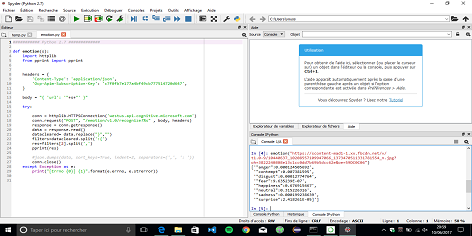

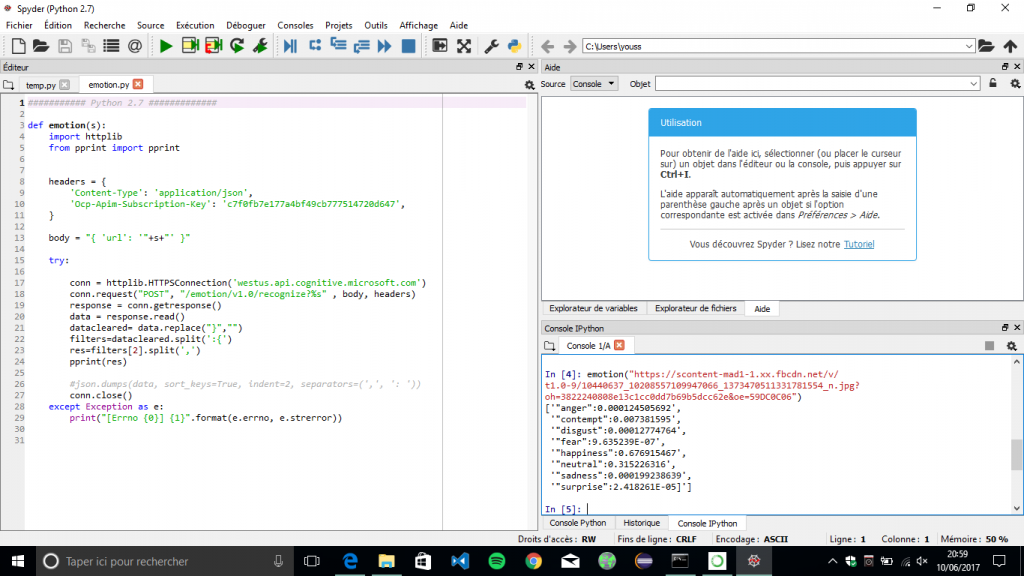

4. Code Python

from pprint import pprint

‘Content-Type’: ‘application/json’,

‘Ocp-Apim-Subscription-Key’:’ Votre Code’,

}

# Type de retour des données et le code d’utilisation de l’API

body = « { ‘url’: ‘Url de votre photo’ } »

# Récupérer l’URL de la photo

conn = httplib.HTTPSConnection(‘westus.api.cognitive.microsoft.com’)

conn.request(« POST », « /emotion/v1.0/recognize?%s » , body, headers)

response = conn.getresponse()

data = response.read()

pprint(data)

5. Pour cette démo j’ai crée une fonction qui prend en paramètre l’URL de la photo et retourne les sentiments de la personne sur la photo.

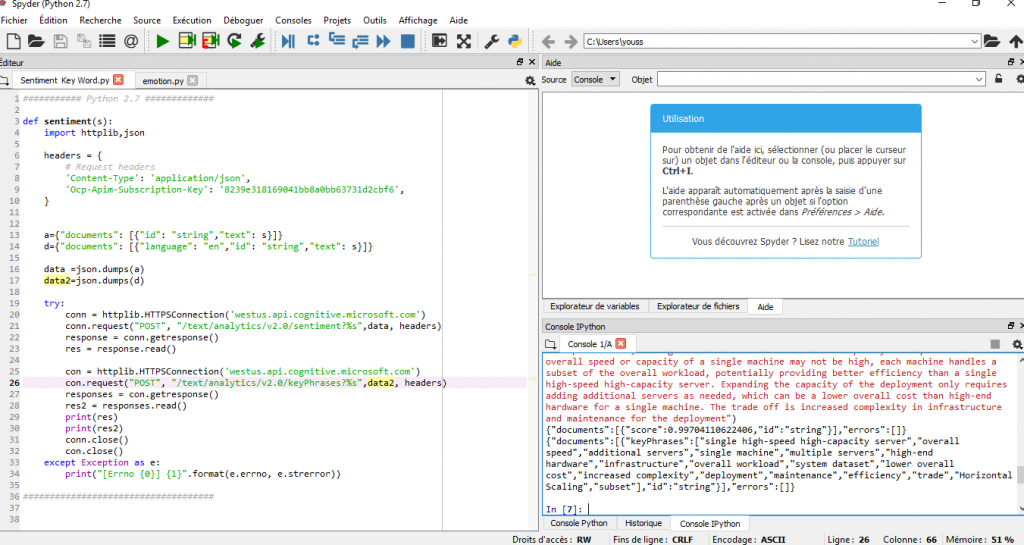

6. Demo des détections des keywords et du sentiments d’un texte

Code source

########### Python 2.7 #############

def sentiment(s):

import httplib,json

headers = {

# Request headers

‘Content-Type’: ‘application/json’,

‘Ocp-Apim-Subscription-Key’: ‘8239e318169041bb8a0bb63731d2cbf6’,

}

a={« documents »: [{« id »: « string », »text »: s}]}

d={« documents »: [{« language »: « en », »id »: « string », »text »: s}]}

data =json.dumps(a)

data2=json.dumps(d)

try:

conn = httplib.HTTPSConnection(‘westus.api.cognitive.microsoft.com’)

conn.request(« POST », « /text/analytics/v2.0/sentiment?%s »,data, headers)

response = conn.getresponse()

res = response.read()

con = httplib.HTTPSConnection(‘westus.api.cognitive.microsoft.com’)

con.request(« POST », « /text/analytics/v2.0/keyPhrases?%s »,data2, headers)

responses = con.getresponse()

res2 = responses.read()

print(res)

print(res2)

conn.close()

con.close()

except Exception as e:

print(« [Errno {0}] {1} ».format(e.errno, e.strerror))

####################################